AI begint met een prompt – ook voor jou als loopbaanprofessional

We hebben AI inmiddels allemaal wel een keer uitgeprobeerd. Maar wat gebeurt er nu werkelijk als je een vraag stelt aan een tool als ChatGPT, Gemini of Claude? En wat betekent dit voor de loopbaanprofessional die AI wil inzetten? In dit tweede artikel van onze AI-reeks duiken we dieper in de werking van AI, om beter te kunnen begrijpen hoe AI slim en effectief ingezet kan worden binnen loopbaanbegeleiding.

Wat is een prompt?

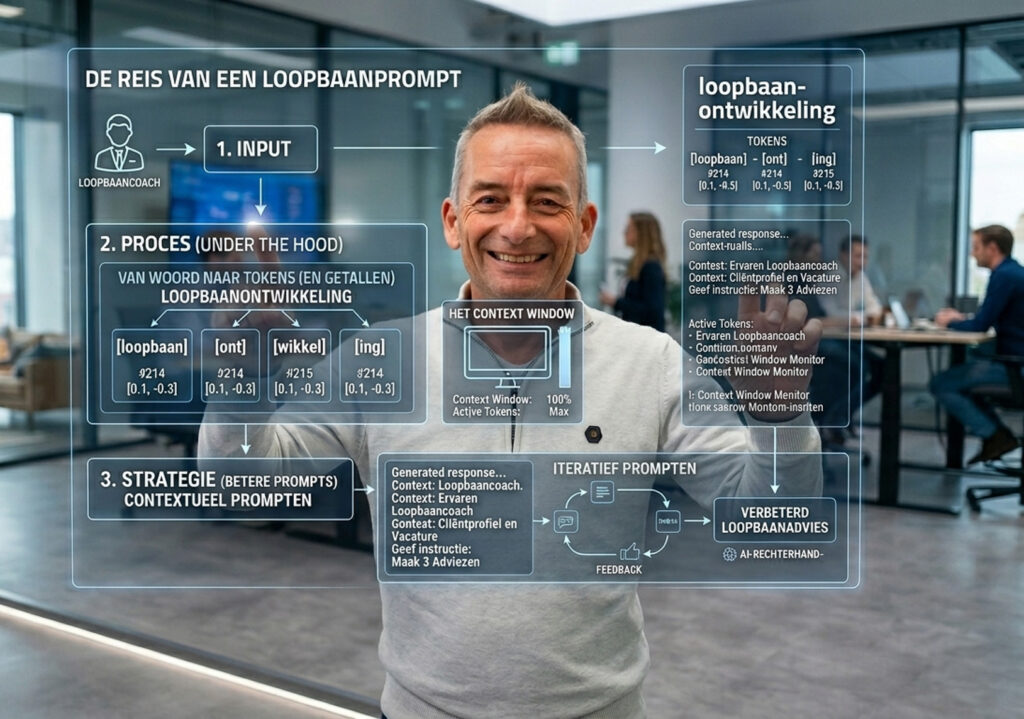

Het dagelijkse gebruik van AI is tegenwoordig heel normaal. Toch bestaat er nog vaak verwarring over het basisbegrip ‘prompt’. Het is eigenlijk vrij eenvoudig: Een prompt is de tekstinput die je aan een AI-model meegeeft. Bijvoorbeeld een vraag, een opdracht of een instructie. Zo kun je bijvoorbeeld aangeven dat je een samenvatting wilt laten maken of een vacaturetekst. Het AI-model gebruikt deze input (prompt) vervolgens als startpunt om een passend antwoord te genereren. Maar ‘onder de motorkap’ gebeurt ondertussen iets heel interessants. AI-modellen verwerken tekst namelijk niet zoals wij mensen dat doen. In plaats van naar woorden of zinnen te kijken, wordt jouw prompt eerst opgedeeld in zogenaamde tokens.

Van woorden naar tokens (en uiteindelijk naar cijfers)

Tokens kun je zien als kleine stukjes tekst. Soms is dat een woord, soms een deel van een woord en soms enkel een leesteken. Het woord loopbaanontwikkeling kan bijvoorbeeld uit meerdere tokens bestaan en een korte zin zelfs al uit tientallen tokens. Al deze tokens worden vertaald naar getallen, waarna het AI-model uiteindelijk kan gaan werken met numerieke representaties. Hierna voorspelt het model welke token waarschijnlijk als volgende komt. En daarna de volgende… En de volgende…

Zo ontstaat er stap voor stap een antwoord. Je kunt het dus het beste zien als een geavanceerd systeem dat continu aan het voorspellen is wat statistisch gezien het meest logische volgende stukje tekst is. Dat klinkt misschien simpel, maar doordat de modellen op enorme hoeveelheden tekst zijn getraind, kunnen ze zeer overtuigende antwoorden genereren. Het goede nieuws? Je hoeft niet precies te begrijpen hoe dit technisch werkt om AI effectief in te kunnen zetten!

Hoe AI door het context window kijkt

Een concept dat je eigenlijk wél wilt kennen, is het context window. Dit bepaalt hoeveel tokens een AI-model tegelijk kan ‘zien’ en meenemen in zijn verwerking. Waar kleinere modellen maar een beperkt aantal tokens tegelijk kunnen verwerken, kunnen grotere modellen juist enorme hoeveelheden tokens aan. In moderne AI-modellen kan dit oplopen tot honderdduizenden of zelfs een miljoen tokens.

Hoe beter de prompt, des te beter het resultaat

Niet elke prompt is hetzelfde. Zo kiezen sommige mensen ervoor om gewoon een vraag te stellen, zonder verdere uitleg of voorbeelden. Dit noemen we in AI-termen ook wel zero-shot prompting. Denk aan de vraag: Wat is de hoofdstad van Frankrijk? Waarop het model een simpel antwoord zal geven: Parijs. Voor complexere taken kun je een AI-model echter beter wat gerichter aansturen. Daarbij zijn er verschillende manieren om je prompt te versterken. Je kunt bijvoorbeeld werken met few-shot prompting. Hierbij geef je het model één of meerdere voorbeelden van het soort antwoord dat je verwacht. Je kunt ook extra context toevoegen. Dit is iets anders dan voorbeelden geven. Context gaat over extra informatie, zoals de situatie, achtergrond of rol waarin het model moet denken.

Door context toe te voegen én duidelijke instructies te geven, vergroot je de kans dat het antwoord aansluit bij wat jij nodig hebt. Voor loopbaanprofessionals kan dit betekenen dat:

- Je een duidelijke rol omschrijft (“Je bent nu een ervaren loopbaancoach”).

- Je context deelt (“Dit is het profiel van een cliënt die…”).

- Je het gewenste format aangeeft (“Geef drie concrete adviezen voor deze situatie”).

Door eventueel ook voorbeelden (few-shot) toe te voegen, stuur je het model nog gerichter in de richting van het gewenste antwoord.

Betere output dankzij interatief prompten of step-by-step prompten

Bij het werken met AI-modellen als Large Language Models (LLM’s) is het belangrijk om te beseffen dat het eerste antwoord niet altijd meteen perfect is. Een veelgebruikte techniek om dan betere resultaten te krijgen, is iteratief prompten. Je begint met een prompt, ontvangt een antwoord en geeft vervolgens feedback of aanvullende instructies. Het model kan dan opnieuw naar zijn antwoord kijken en een verbeterde versie genereren. Dit proces herhaal je totdat het gewenste resultaat bereikt is.

Een andere effectieve aanpak is het opsplitsen van een taak in meerdere stappen. Dit wordt ook wel scaffolding genoemd (of step-by-step prompting). In plaats van één grote opdracht geef je het model kleinere, opeenvolgende subtaken, zoals eerst een outline maken, daarna een introductie schrijven en vervolgens elke sectie afzonderlijk uitwerken. Dit maakt complexe opdrachten beter beheersbaar en zorgt vaak voor betere resultaten. Daarnaast kun je AI vragen om op zijn eigen output te reflecteren en verbeterpunten te zoeken. Door deze technieken slim te combineren, kun je AI-modellen veel effectiever inzetten.

Van losse prompts naar AI-workflows

AI wordt steeds vaker onderdeel van grotere processen. In plaats van één vraag te stellen, kun je meerdere stappen op laten volgen. Hoewel de term ‘AI-agent’ vaak wordt gebruikt, gaat het in de praktijk vaak gewoon om slimme workflows. Zo’n workflow kan bijvoorbeeld bestaan uit meerdere stappen:

- Informatie analyseren

- Samenvatten

- Patronen herkennen

- Adviezen formuleren

Elke stap kan hierbij door een aparte prompt worden uitgevoerd. Dit wordt ook wel prompt chaining genoemd. Oftewel; meerdere prompts die achter elkaar worden uitgevoerd.

Van resultaat naar de juiste prompt

Je kunt AI niet alleen vragen stellen, maar ook gebruiken om je eigen prompts te verbeteren. Dat doe je met reverse prompting. Hierbij begin je niet met de vraag, maar met het gewenste resultaat. Heb je een goed artikel of output? Vraag AI dan: “Welke prompt zou leiden tot dit resultaat?” Zo leer je hoe je AI gerichter kunt aansturen.

Een stap verder is (reverse) meta prompting. Dit gebruik je als je via meerdere stappen en aanpassingen tot een goed resultaat bent gekomen. In plaats van dat hele proces opnieuw te doorlopen, vraag je AI: “Maak op basis van dit gesprek één sterke prompt waarmee ik dit resultaat in één keer kan krijgen.” Zo bouw je een handige snelkoppeling voor de toekomst.

Tools zoals Perplexity kunnen dit proces versnellen, bijvoorbeeld door automatisch een gestructureerde prompt voor je te genereren. Dit is vooral handig als je nog zoekende bent naar de juiste formulering of aanpak.

Wat is nu de vervolgstap voor loopbaanprofessionals?

Je hoeft als loopbaanexpert dus geen AI-expert te zijn of worden. Wel helpt het enorm als je begrijpt dat AI werkt met prompts, het systeem statistisch voorspelt, betere instructies betere resultaten geven en AI-toepassingen vaak uit meerdere stappen bestaan. Met deze inzichten kunnen we AI gerichter inzetten voor onder andere de analyse van intakegesprekken. Maar ook bij het genereren van reflectievragen, het voorbereiden van coachgesprekken of het maken van rapportages kan AI jouw rechterhand worden. En dat is precies wat we bij Rapasso zo interessant vinden. Niet losse tools van AI gebruiken, maar AI structureel gebruiken om loopbaanprofessionals te ondersteunen.

In het volgende artikel in deze reeks kijken we daarom verder naar de technieken achter slimme AI-processen in het veld van loopbaanbegeleiding. Want de echte vraag is niet meer óf AI een rol gaat spelen, maar hoe we het zo gaan inzetten dat het jou als professional sterker maakt.

Meer weten over Rapasso?

Vraag een gratis vrijblijvende demo aan en zie wat Rapasso voor je kan betekenen.

Door dit formulier te versturen ga je akkoord met onze privacyverklaring.

Wij scoren een 8.7 op klanttevredenheid – 100% beveelt ons aan