Wat elke loopbaanorganisatie moet weten over de nieuwe AI-regelgeving

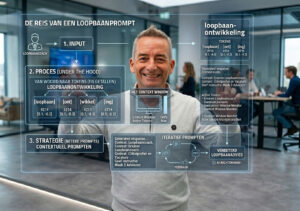

AI schuift in snel tempo op van experiment naar vast onderdeel binnen loopbaanorganisaties. Gespreksverslagen worden automatisch samengevat, documenten geanalyseerd, rapportages (deels) voorbereid en matching of profielvorming krijgt ondersteuning van slimme systemen. Dat helpt bij tijdsdruk en dossiervorming, maar brengt ook een andere vraag op tafel: niet meer alleen wat kan AI, maar vooral hoe gebruik jij AI zo dat het jouw professionaliteit versterkt én je jouw verantwoordelijkheid goed invult?

Daar zit ook meteen de kern van het verhaal. AI komt terecht op plekken waar professioneel oordeel essentieel is: bij verslaglegging, bij rapportages richting opdrachtgevers, bij matching en bij profielvorming. Op die momenten wil je dat AI helpt, maar niet bepaalt. Het verschil tussen een handig hulpmiddel en een sturende factor is soms klein, en juist daarom wordt verantwoord gebruik belangrijker dan alleen slim gebruik.

AI‑verordening: nieuwe kaders naast de AVG

De Europese AI-verordening (AI Act) is inmiddels vastgesteld en treedt stapsgewijs in werking. Dit is Europese regelgeving die regels stelt voor de ontwikkeling en het gebruik van AI-systemen. Je kunt dit het beste vergelijken met de Algemene verordening gegevensbescherming (AVG): waar de AVG de regels bepaalt voor privacy, bepaalt de AI-verordening de regels voor het verantwoord gebruik van AI-systemen in Europa.

In veel organisaties is privacy het eerste waaraan wordt gedacht zodra het over AI gaat. Dat is terecht, maar het dekt niet alles: de AI-verordening gaat nadrukkelijk óók over zaken als zorgvuldige besluitvorming, transparantie, non-discriminatie en menselijk toezicht bij het gebruik van AI-systemen.

De kern van de nieuwe regelgeving is dat alle AI-systemen die we in de EU gebruiken veilig zijn en de grondrechten van mensen respecteren. Daarbij maakt het niet uit of een systeem in Europa of elders in de wereld is ontwikkeld. Om dit beheersbaar te houden, werkt de regelgeving met verschillende risicocategorieën: hoe groter de impact van een AI-systeem op iemands leven of rechten, hoe strenger de regels die ervoor gelden.

Binnen deze indeling vallen de AI-systemen waar loopbaanorganisaties mee werken vrijwel altijd in de categorie hoog-risico, omdat zij invloed hebben op de kansen van mensen in het arbeidsleven. Concreet vallen toepassingen rondom werving, selectie, taaktoewijzing en de evaluatie van prestaties onder deze strenge categorie.

Voor loopbaanorganisaties is vooral 2 augustus 2026 een belangrijke datum. Vanaf dat moment moeten AI-systemen binnen de hoog-risicocategorie voldoen aan de volledige set verplichtingen. Voor organisaties die AI gebruiken in trajecten, matching of rapportages is dat geen ver-van-mijn-bedontwikkeling, maar juist het moment waarop zij erop kunnen vertrouwen dat AI-systemen die zij inzetten betrouwbaar en van hoge kwaliteit zijn. Tegelijkertijd is dit het startpunt waarop van organisaties wordt verwacht dat de basis op orde is en zij hun keuzes kunnen uitleggen richting opdrachtgevers en toezichthouders.

ISO 42001: jouw houvast voor verantwoord AI

Om aan die nieuwe regelgeving te voldoen en de “basis op orde” te krijgen, is er een internationaal hulpmiddel beschikbaar: de ISO 42001-norm. Je kunt dit zien als een kwaliteitskeurmerk specifiek voor AI. Waar de AI-verordening zegt wat je moet doen, helpt deze norm organisaties bij het hoe. Het biedt een heldere structuur voor afspraken over beleid, rollen en het beheersen van risico’s.

Voor leveranciers van software en AI-functionaliteit is deze norm essentieel: zij bouwen, integreren en beheren AI in hun producten en moeten kunnen laten zien hoe zij risico’s beheersen en verantwoordelijkheden verdelen.

Loopbaanorganisaties zijn meestal geen aanbieder van AI, maar gebruiker – in de terminologie van de AI-verordening: deployer van AI-systemen. Zij hoeven niet allemaal zelf naar ISO 42001-certificering te streven, maar hebben er wél baat bij als hun leveranciers hun AI-governance op orde hebben. Het geeft je de zekerheid dat de techniek die je gebruikt voldoet aan de juiste eisen. Intern hoef je dan alleen nog maar afspraken te maken over het gebruik: wie gebruikt welke tool, en hoe borgen we dat het menselijk oordeel altijd leidend blijft?

Waar AI nu al invloed heeft op het werk

Terwijl je de basis op orde brengt, merk je dat AI nu al onderdeel is van je werk. Zo wordt AI bijvoorbeeld ingezet bij:

- Slimme matching:AI die suggesties of scores geeft voor passende vacatures of loopbaanrichtingen.

- Rapportage-ondersteuning:AI die conceptteksten of samenvattingen genereert voor rapportages aan werkgevers, gemeenten of het UWV.

- Profielvorming:Generatieve AI die profielteksten of korte samenvattingen produceert die uiteindelijk in een dossier terechtkomen.

Op zichzelf zijn dat nuttige toepassingen. Maar in al deze situaties geldt dat de uitkomst invloed kan hebben op hoe naar een cliënt wordt gekeken en welke vervolgstappen worden gezet. Dan wil je als organisatie kunnen uitleggen welke rol AI speelt én hoe het professionele oordeel aan zet blijft.

Menselijk toezicht: human‑in‑the‑loop als randvoorwaarde

Juist bij dit soort toepassingen komt een belangrijk principe uit de AI‑verordening naar voren: menselijk toezicht. Voor AI‑systemen die in beginsel onder de hoog‑risico‑categorie vallen verwacht de AI-verordening nadrukkelijk dat mensen in staat blijven om uitkomsten te begrijpen, te beoordelen en zo nodig te corrigeren. Dit wordt vaak aangeduid als human‑in‑the‑loop. In de praktijk betekent dat voor loopbaanorganisaties bijvoorbeeld dat:

- Een matchsuggestie of score nooit een besluit is, maar een startpunt voor gesprek en professionele afweging;

- Een AI-gegenereerde rapportage niet ongezien het dossier in gaat, maar inhoudelijk wordt beoordeeld en zo nodig aangepast;

- Profielteksten en samenvattingen altijd worden getoetst aan wat de professional weet van de cliënt en het traject.

Zo blijft AI ondersteunend en blijft het professionele oordeel nadrukkelijk aan zet – precies de balans waar de AI‑verordening op stuurt bij toepassingen in het werk‑ en dienstendomein.

AI een plek geven in bestaande structuren

Voor loopbaanorganisaties betekent dit niet dat zij een volledig nieuw stelsel hoeven op te tuigen. Veel bouwstenen zijn er al: kwaliteitszorg, privacybeleid, informatiebeveiliging, dossiervorming en interne audits. De stap die nu nodig is, is om AI expliciet een plek te geven binnen die bestaande structuren. Concreet gaat het dan om vragen als:

- Waar gebruiken we AI precies voor in onze trajecten en processen?

- Waar mag AI alleen ondersteunen en waar kan de uitkomst meer sturend worden?

- Hoe zorgen we dat medewerkers begrijpen wat een AI‑functie wel en niet doet?

- Welke afspraken maken we met leveranciers over transparantie, kwaliteit en beperkingen van AI‑functionaliteit?

Die vragen liggen dicht tegen de principes van ISO 42001 aan, zonder dat iedere organisatie de norm letterlijk hoeft te implementeren. Ze helpen om AI niet als los hulpmiddel te zien, maar als onderdeel van de manier waarop je als organisatie laat zien: wij werken zorgvuldig en verantwoord.

Wat jouw opdrachtgevers gaan verwachten

Voor opdrachtgevers van loopbaanorganisaties – UWV, gemeenten, werkgevers, overheidsinstellingen en verzekeraars – wordt dit tegelijk een steeds belangrijker thema. Zij krijgen zelf te maken met hogere verwachtingen rond verantwoord AI-gebruik en zullen in aanbestedingen en contracten meer willen weten over de inzet van AI in dienstverlening:

- Hoe transparant is het gebruik?

- Hoe blijft menselijk oordeel leidend?

- Hoe wordt voorkomen dat AI-uitkomsten te sturend worden?

Bovendien willen zij inzicht in welke onderdelen van een traject of rapportage (mede) door AI zijn gegenereerd of beïnvloed. Denk daarbij bijvoorbeeld aan het kunnen uitleggen welke delen van een verslag, analyse of matchvoorstel met AI-ondersteuning tot stand zijn gekomen, en hoe die vervolgens door professionals zijn beoordeeld en waar nodig bijgestuurd. Dat vraagt om een gezamenlijk verhaal van leverancier én loopbaanorganisatie: de één over de inrichting van het systeem, de ander over het gebruik ervan in de praktijk.

De rol van Rapasso in deze ontwikkeling

Voor een leverancier als Rapasso ligt daar dan ook een dubbele rol. Enerzijds het ontwikkelen, inkopen, koppelen en integreren van AI‑functionaliteit die echt iets toevoegt aan het werk van loopbaanprofessionals. Anderzijds het zorgen voor een kader waarin die functionaliteit verantwoord kan worden gebruikt – met duidelijkheid over wat AI doet, welke grenzen er zijn, waar menselijk toezicht nodig blijft en hoe zichtbaar is welke onderdelen van processen en rapportages door AI zijn ondersteund. Daarmee ontstaat voor loopbaanorganisaties een stevigere basis: niet alleen toegang tot slimme AI‑ondersteuning, maar ook steeds meer zekerheid dat die ondersteuning past binnen een verantwoord ingericht kader.

Zo werk jij straks aantoonbaar verantwoord met AI

Voor loopbaanorganisaties zelf gaat het er uiteindelijk vooral om AI bewust, uitlegbaar en binnen herkenbare kaders te gebruiken. Niet alles hoeft anders, maar AI moet wel een expliciete plek krijgen in beleid, werkafspraken en kwaliteitsborging. AI kan veel werk lichter maken, zolang helder blijft wie waarvoor verantwoordelijk is en zolang het professionele oordeel van loopbaanprofessionals de doorslag geeft. Wie dat nu goed organiseert, gebruikt AI niet alleen slim, maar ook aantoonbaar verantwoord – en is daarmee klaar voor de vragen die opdrachtgevers, cliënten en regelgeving in de komende jaren gaan stellen.

Wie zich verder wil verdiepen in de AI-verordening zelf, vindt op Digitale Overheid een heldere Nederlandstalige uitleg over uitgangspunten, risicocategorieën en de belangrijkste verplichtingen voor organisaties.

Meer weten over Rapasso?

Vraag een gratis vrijblijvende demo aan en zie wat Rapasso voor je kan betekenen.

Door dit formulier te versturen ga je akkoord met onze privacyverklaring.

Wij scoren een 8.7 op klanttevredenheid – 100% beveelt ons aan